¿Puede utilizarse la IA para convertir un escáner cerebral en música?

El proyecto "Brain2Music" entre Google y la Universidad de Osaka muestra como se puede usar la IA para generar música directamente a partir de los pensamientos

Google y la Universidad de Osaka (Japón) han publicado un estudio que muestra una técnica totalmente innovadora para convertir la actividad cerebral en música.

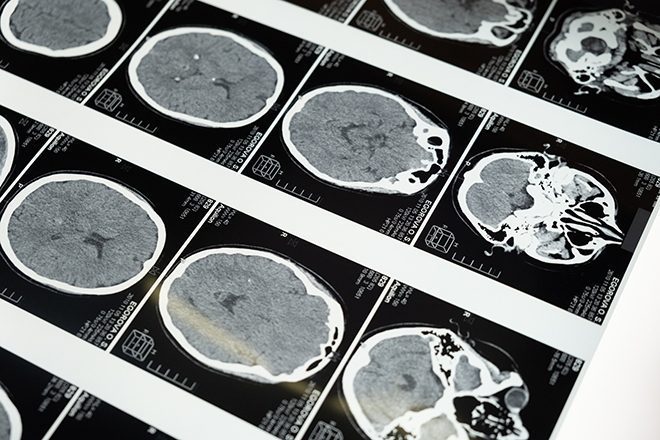

Para realizar la investigación, se colocaron a cinco voluntarios en un escáner de resonancia magnética funcional y les sometieron a la reproducción de más de 500 pistas de 10 estilos musicales diferentes. La actividad cerebral creó imágenes que se capturaron e integraron en Music LM, un generador de música por IA de Google, lo que resulto en que el software estuviese condicionado por los patrones cerebrales y las respuestas de los individuos.

La música creada era similar a los estímulos que recibían los sujetos, con sutiles variaciones semánticas. El resumen del informe dice que "La música generada se asemeja a aquellos estímulos musicales a los que fueron expuestos los sujetos, desde el punto de vista de propiedades semánticas como el género, la instrumentación y el estado de ánimo".

El estudio también ha descubierto que hay solapamiento en las regiones cerebrales responsables de "representar la información derivada de la superposición de texto y música", observando similitudes entre dos componentes de MusicLM y la actividad cerebral en el córtex auditivo.

Las conclusiones de los investigadores, en resumen, decían que "cuando un humano y MusicLM están expuestos a la misma música, las representaciones internas de MusicLM se correlacionan con la actividad cerebral en determinadas regiones".

Y continuaba: "Cuando utilizamos los datos de esas regiones como entrada para MusicLM, podemos predecir y reconstruir los tipos de música a los que estuvo expuesto el sujeto humano".

Aunque se cree que esta investigación podría acercarnos a la traducción de pensamientos en música mediante algún tipo de software hiperinteligente, el artículo señalaba que construir un modelo universal sería difícil, ya que la actividad cerebral difiere mucho de una persona a otra. El siguiente paso sería encontrar una forma de crear música a partir de la imaginación humana, en lugar de estímulos introducidos.

Puedes consultar en este enlace el artículo completo, donde también pueded escuchar la música generada por la IA.